Dein MVP ist live. Du hast Monate in die Entwicklung investiert, das Pitch-Deck poliert, die ersten User ongeboardet – und dann: Funkstille. Kein organisches Wachstum, keine Retention, kein Product-Market-Fit. Was ist passiert?

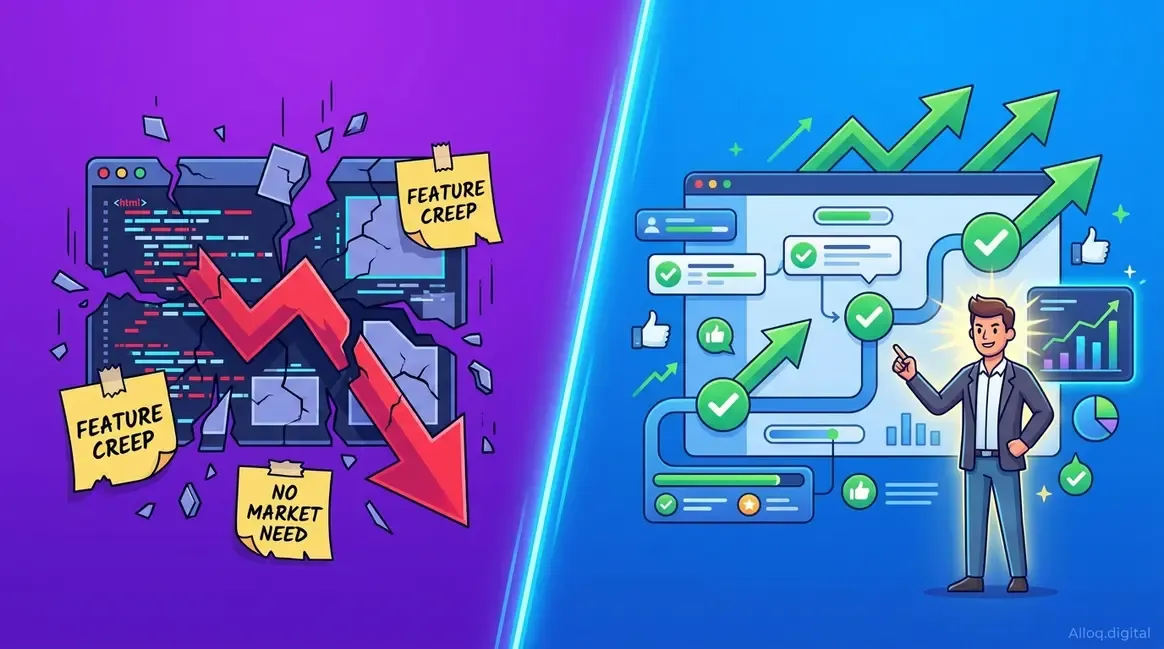

Der Fehler liegt selten im Code. 42 % aller gescheiterten Startups nennen fehlenden Marktbedarf als primären Misserfolgsgrund (CB Insights, 2026) – und das bedeutet: Das Produkt wurde gebaut, bevor das Problem wirklich verstanden wurde. Die Build-First-Falle schnappt zu, lange bevor der erste User die App öffnet. In unserer eigenen Beratungsarbeit bei Alloq sehen wir regelmäßig, dass Gründer echtes Nutzerfeedback durch eigene Gewissheit ersetzen.

Dieser Artikel analysiert die fünf häufigsten strukturellen Ursachen für das Scheitern von MVPs, zeigt sieben reale Post-Mortem-Beispiele und stellt dir moderne Alternativen vor, die das Fundamentalproblem beim Namen nennen. Für Gründer, Produktmanager und Entwickler, die ihren nächsten Launch anders angehen wollen.

Key Takeaways

MVPs scheitern in 42 % der Fälle nicht am Produkt, sondern an fehlender Marktvalidierung – die “Build-First-Falle” ist der häufigste und am schwersten korrigierbare Fehler in der frühen Startup-Phase.

- Die 5 Kernursachen: Falsche Problemdefinition, Feature Creep, Bestätigungsfehler, Investor-getriebene Entwicklung und technisches Over-Engineering vor dem PMF.

- Reale Post-Mortems: Quibi, Juicero, Jawbone und vier weitere zeigen, wie selbst gut finanzierte Teams in dieselben Fallen tappen.

- Die Build-First-Falle: Das Phänomen, bei dem Gründer je tiefer sie investieren, desto schwerer konträres Marktfeedback akzeptieren können – erkennbar und vermeidbar.

- Moderne Alternativen: SLC (Simple, Lovable, Complete), MAP (Minimum Awesome Product) und MVA (Minimum Viable Architecture) bieten strukturiertere Wege zur Validierung.

Was ist ein MVP? Grundlagen & Irrtümer

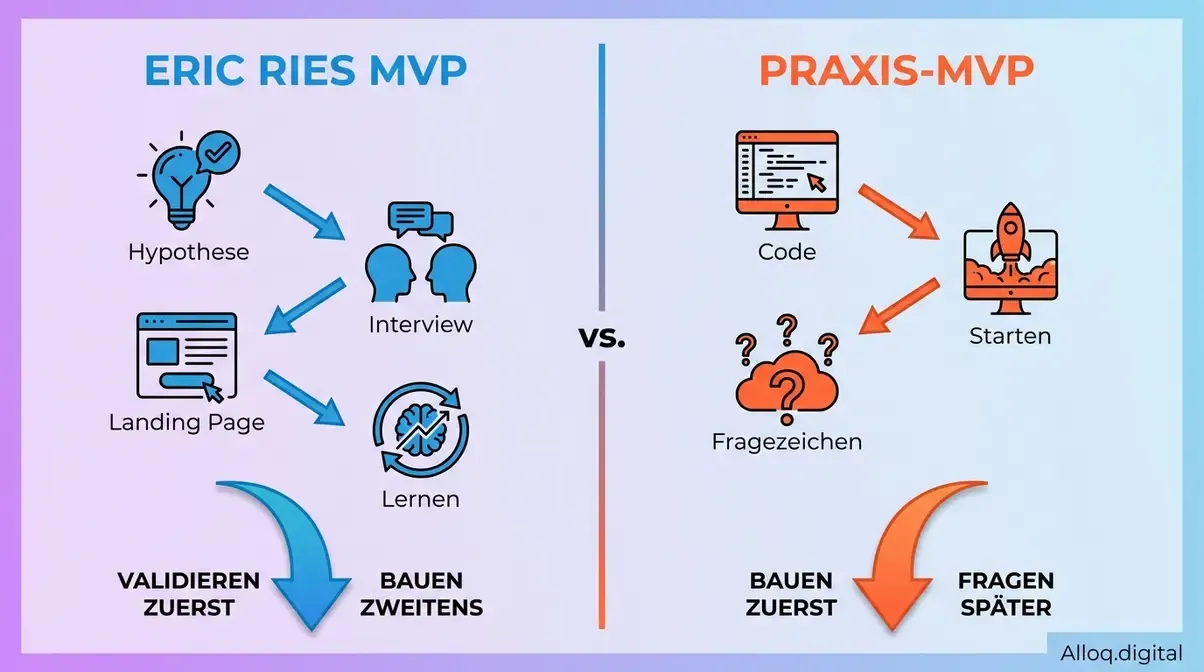

Ein Minimum Viable Product (MVP) ist nach Eric Ries’ Definition das kleinste Produkt, mit dem ein Team den maximalen validierten Lerneffekt über Kunden mit minimalem Aufwand erzielt – nicht das kleinste Produkt, das man irgendwie launchen kann. Dieser Unterschied klingt akademisch, hat aber gravierende praktische Konsequenzen.

In der Praxis wird der Begriff auf zwei grundlegend verschiedene Arten interpretiert: Als Lernwerkzeug (Ries’ ursprüngliche Intention) oder als erster Produktrelease (häufige Fehlinterpretation). Teams, die MVPs als frühe Produktversion sehen, sparen sich oft die unangenehme Validierungsarbeit – und bauen stattdessen monatelang an etwas, das niemand wirklich braucht.

Eric Ries vs. Praxis-Realität

Eric Ries beschrieb das MVP 2011 im Lean-Startup-Kontext als Hypothesentest. Das Ziel: Herausfinden, ob eine Annahme über Kunden, Markt oder Lösung stimmt – mit möglichst wenig Ressourceneinsatz. Ein MVP könnte ein Interview-Leitfaden sein, eine Landing Page ohne Backend oder ein manuell betriebener Service, der Automatisierung simuliert.

Was viele Teams stattdessen bauen, ist ein MLP (Minimum Launchable Product) – ein funktionierendes, aber zu früh gebautes Produkt ohne vorherige Hypothesenvalidierung. Der Unterschied ist entscheidend: Ein echtes MVP beantwortet Fragen, bevor Code geschrieben wird. Ein fehlgeleitetes MVP ist der Code, der die Fragen hätte beantworten sollen.

Ries’ Original-MVP validiert Hypothesen bevor gebaut wird — die Praxis kehrt diese Reihenfolge häufig um, mit teuren Konsequenzen.

Ries’ Original-MVP validiert Hypothesen bevor gebaut wird — die Praxis kehrt diese Reihenfolge häufig um, mit teuren Konsequenzen.

Caption: Der fundamentale Unterschied – Ries’ MVP validiert Hypothesen, bevor gebaut wird; die Praxis kehrt diese Reihenfolge oft um.

Die 5 häufigsten Gründe, warum MVPs scheitern

Die Überlebensrate von Startups in Deutschland liegt nach fünf Jahren nur noch bei etwa 38 % (IfM Bonn, 2026) – das Scheitern ist statistisch die Regel, nicht die Ausnahme. Was sich in Dutzenden Post-Mortem-Analysen immer wieder zeigt: Hinter dem Scheitern einzelner MVPs stehen dieselben fünf strukturellen Muster. Das ist keine Entwarnung – es ist eine Einladung, sie rechtzeitig zu erkennen.

Problem- & Marktvalidierung fehlen

Das häufigste Todesurteil für ein MVP lautet nicht „schlechter Code”, sondern „falsches Problem” – 42 % der gescheiterten Startups geben an, an einem Problem gearbeitet zu haben, das für zahlende Kunden keine ausreichende Priorität hatte (CB Insights, 2026). Kein Go-to-Market-Talent und kein Wachstums-Hack korrigiert diesen Fundamentalfehler im Nachhinein.

Das Tückische: Gründer, die in ihrer Branche oder Community verwurzelt sind, haben oft eine gefühlte Gewissheit über das Problem. Sie erleben es selbst, sie kennen andere, die es erleben – das reicht als Validierung aber nicht. Was fehlt, ist der Nachweis, dass die Zielgruppe bereit ist, Zeit, Geld oder Verhalten zu verändern, um das Problem zu lösen.

Konkret zeigt sich die fehlende Marktvalidierung in mehreren Symptomen: keine Zahlungsbereitschaft bei echten (nicht befreundeten) Nutzern, kaum organische Nachfrage ohne aktives Pushing, und Nutzungsabbrüche schon beim ersten Kontakt. Fraunhofer-Forschungen zur Digitalisierung mittelständischer Unternehmen bestätigen, dass fehlende Marktorientierung im MVP-Prozess die häufigste Ursache für das Scheitern digitaler Produktentwicklungen ist – auch in etablierten Unternehmen, nicht nur bei Startups.

Die Konsequenz ist eindeutig: Wer nicht validiert, bevor er baut, kauft sich ein teures Lernticket – finanziert mit Entwicklerzeit, Investorenkapital und Opportunitätskosten, die anderswo besser eingesetzt worden wären.

Minimum-Irrtum & Feature Creep

Feature Creep ist die stille Epidemie der MVP-Entwicklung – das schleichende Hinzufügen von Features, die das Kernproblem nicht lösen, aber die Entwicklungszeit verdoppeln. Es beginnt harmlos: Ein Gründer fügt das Feature hinzu, das Investor X im letzten Meeting erwähnt hat. Ein anderer ergänzt die Funktion, die ein potenzieller Großkunde gerne hätte. Nach sechs Monaten ist das „Minimum” nicht mehr minimal.

Die Ursprungsidee des MVPs fordert radikale Reduktion: Welches eine Problem löst dieses Produkt, und was ist die kleinstmögliche Lösung dafür? In der Praxis verwechseln Teams „minimal” mit „billig gebaut”, nicht mit „eng fokussiert”. Das Ergebnis sind überkomplexe erste Versionen, die zu lange dauern, zu viel kosten – und den Validierungsmoment so weit in die Zukunft verschieben, dass das Team längst Sunk-Cost-getrieben denkt.

Ein verlässlicher Frühindikator: Wenn ein MVP mehr als zwei bis drei Kernfeatures hat, bevor der erste externe Nutzer Feedback gegeben hat, ist Feature Creep bereits aktiv. Die richtige Frage lautet nicht „Was braucht das Produkt?”, sondern „Was müssen wir weglassen, damit wir in vier Wochen Feedback bekommen?”

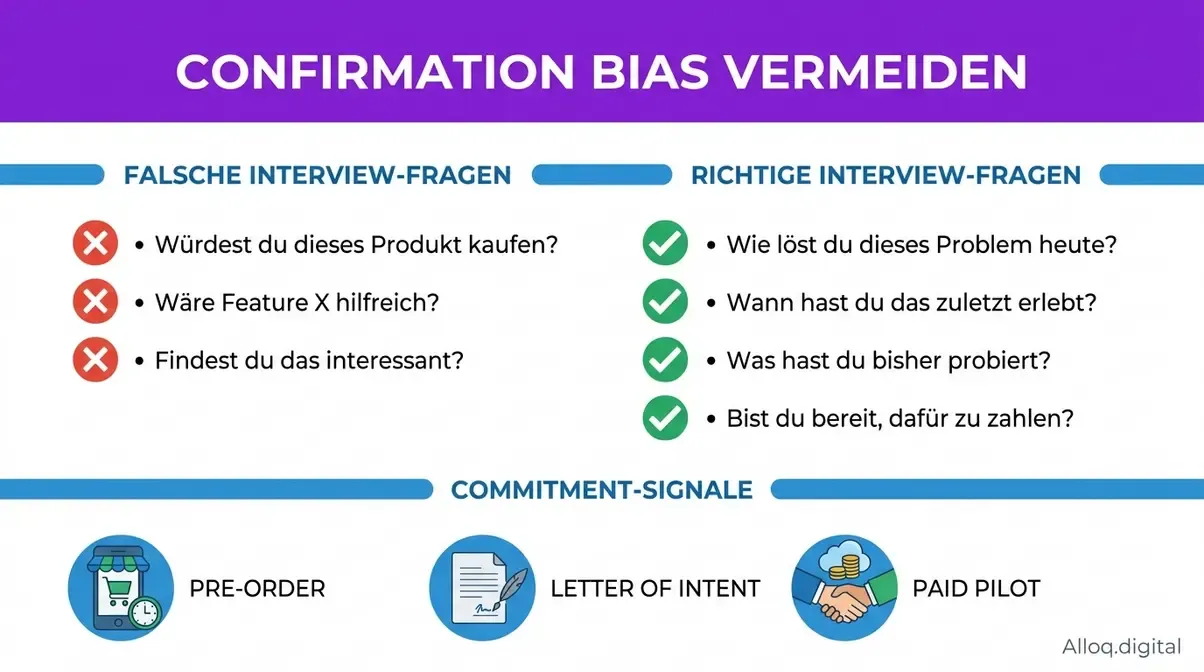

Bestätigungsfehler bei Interviews

Bestätigungsfehler (Confirmation Bias) ist der heimtückischste Gegner der Marktvalidierung, weil er wie echte Forschung aussieht – aber in die entgegengesetzte Richtung zieht. Gründer führen Dutzende Interviews, hören überall „interessant” und „ja, das wäre hilfreich” – und interpretieren das als grünes Licht. Was sie überhören: die weichen Zögerer, die Nicht-Antworten, die höflichen Ausweichmanöver.

Das Problem liegt oft im Interviewdesign selbst. Wer fragt „Würdest du dieses Produkt nutzen, wenn es X, Y und Z könnte?”, bekommt zuverlässig Zustimmung – Menschen sind soziale Wesen und sagen ungern nein, besonders zu Gründern, die ihnen ihr Herzprojekt pitchen. Valide Validierung funktioniert anders: Sie fragt nach Verhalten, nicht nach Hypothesen. „Wie löst du dieses Problem heute?” ist wertvoller als „Würdest du dieses Produkt kaufen?”

Falsche Interview-Fragen erzeugen Zustimmung statt Wahrheit — diese Checkliste zeigt, wie valide Kundenvalidierung aussieht.

Falsche Interview-Fragen erzeugen Zustimmung statt Wahrheit — diese Checkliste zeigt, wie valide Kundenvalidierung aussieht.

Die Antler-Methode und andere strukturierte Frameworks empfehlen, Commitments statt Meinungen zu erheben: Vorbestellungen, bezahlte Pilotprogramme, Letter-of-Intent-Unterzeichnungen. Wenn ein potenzieller Kunde nicht bereit ist, Geld oder Zeit zu investieren, bevor das Produkt fertig ist, ist das kein Validierungssignal – es ist das Gegenteil.

Quotable Statement: “Das ehrlichste Marktvalidierungssignal ist die erste bezahlte Vorbestellung – nicht das höfliche ‘klingt interessant’ aus dem Kundeninterview.”

Die gefährliche Pitch-Deck-Mentalität

Wenn ein MVP primär dafür gebaut wird, Investoren zu beeindrucken statt Kundenprobleme zu lösen, verliert es seinen eigentlichen Zweck – und wird zum teuren Prototypen für eine Präsentation. Diese Verwechslung ist häufiger als gedacht: Teams priorisieren Features, die im Demo gut aussehen, gegenüber Funktionen, die echten Nutzernutzen liefern. Schöne Dashboards, saubere UX-Flows, ausgereifte Oberflächen – all das kostet Zeit und Geld, die besser in Kundenvalidierung geflossen wären.

Die Pitch-Deck-Mentalität entsteht oft durch strukturelle Fehlanreize: Wer früh auf Fundraising angewiesen ist, baut für die Audienz, die die Finanzierung kontrolliert. Das ist rational – aber strategisch riskant. Investoren finanzieren Teams, die Marktbeweise liefern können, nicht Teams, die gut designte Prototypen zeigen. Echte Traction – auch mit einem hässlichen MVP – ist überzeugender als ein poliertes Produkt ohne Nutzer.

Hier schnappt die Build-First-Falle am härtesten zu: Je mehr in Entwicklung investiert wurde, desto schwerer fällt es, konträres Marktfeedback zu akzeptieren. Das Founder’s Paradox zeigt sich hier in seiner reinsten Form – die emotionale und finanzielle Investition in das Produkt macht objektive Marktbewertung psychologisch immer schwieriger.

Technisches Scheitern vor dem PMF

Technische Schulden und Over-Engineering vor dem PMF sind die kostspieligen Nebenprodukte der Pitch-Deck-Mentalität – Startups bauen Infrastruktur für Millionen von Nutzern, bevor sie die ersten Hundert haben. Das ist keine Ausnahme, sondern ein verbreitetes Muster: Teams investieren in Skalierbarkeit, bevor Skalierung überhaupt ein reales Problem ist.

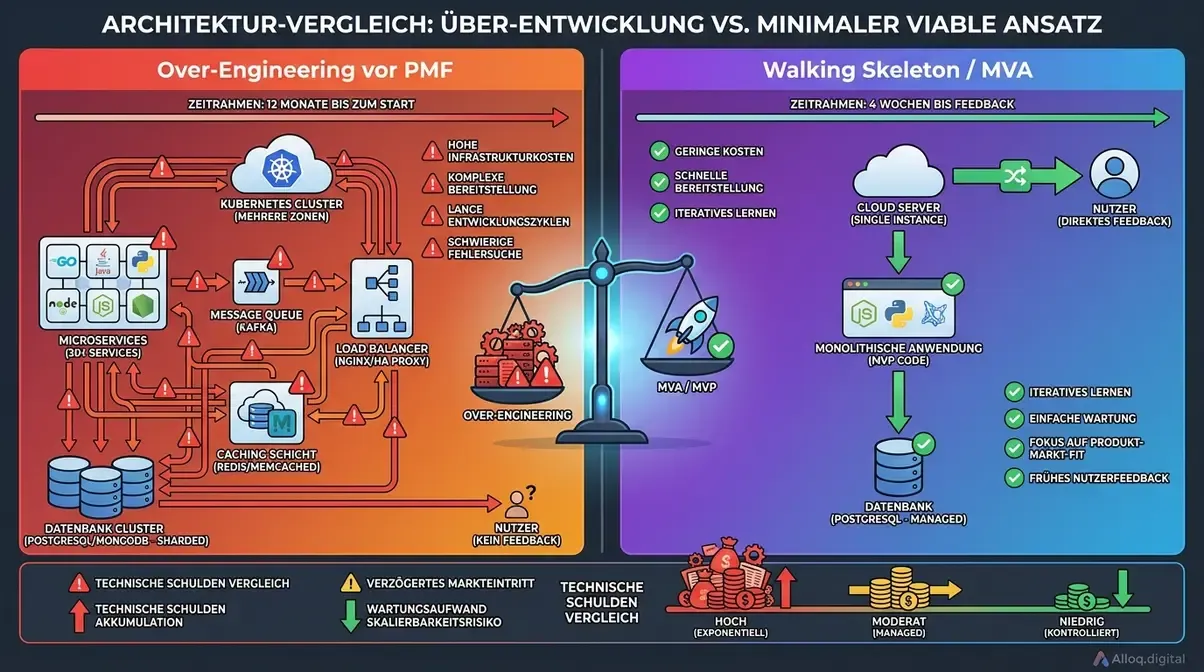

Over-Engineering vor dem PMF verdoppelt Entwicklungszeiten — der Walking Skeleton liefert dasselbe Feedback in einem Viertel der Zeit.

Over-Engineering vor dem PMF verdoppelt Entwicklungszeiten — der Walking Skeleton liefert dasselbe Feedback in einem Viertel der Zeit.

Das Ergebnis: Entwicklungszyklen verdoppeln sich, technische Komplexität erhöht den Wartungsaufwand, und das Team verliert sich in Infrastrukturproblemen, statt Kundenfeedback zu verarbeiten. Laut Fraunhofer IESE ist technisches Over-Engineering vor der Marktreifephase einer der Hauptgründe, warum digitale Produktentwicklungen in der Pilotphase stagnieren, besonders in der Software-Modernisierung bestehender Systeme.

Der konstruktive Gegenentwurf ist der Walking Skeleton – ein technisches Minimal-Framework, das nur die absolut notwendige Infrastruktur enthält, um Feedback zu ermöglichen. Nichts ist für die Ewigkeit gebaut, aber alles ist echten Nutzern zugänglich. Skalierbarkeit wird erst dann gebaut, wenn der PMF nachgewiesen ist – nicht vorher.

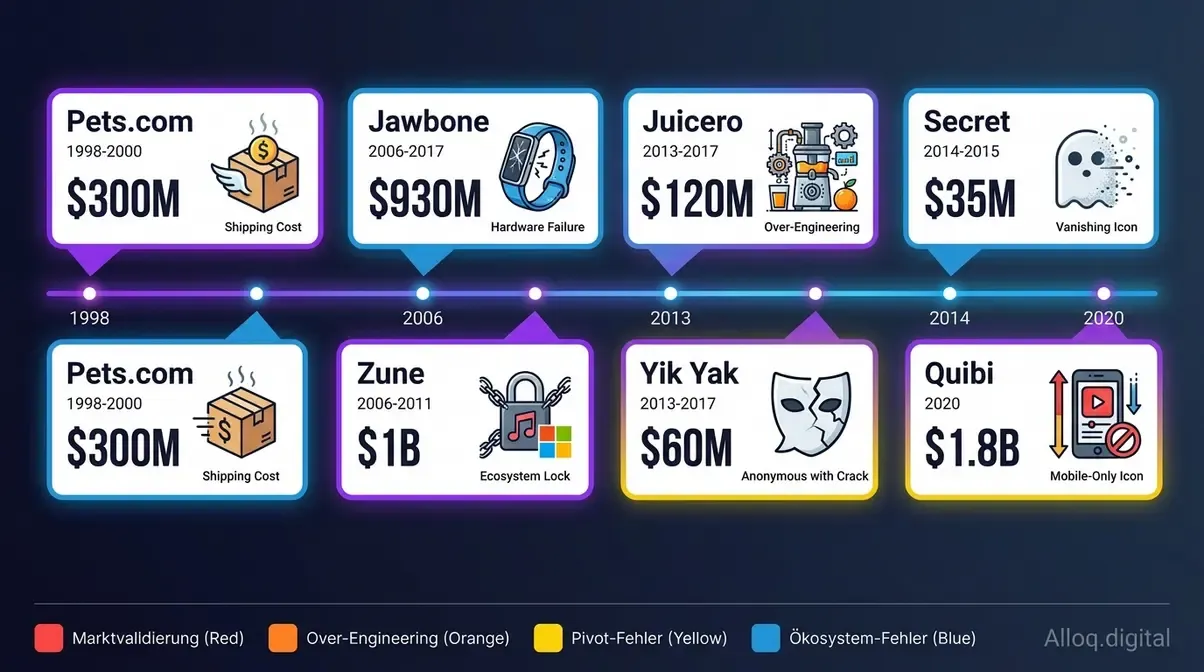

7 reale Startup-Post-Mortems im Fokus

Die folgenden sieben Beispiele sind keine akademischen Fallstudien – es sind dokumentierte Fehler von Teams mit Millionenfinanzierungen, erfahrenen Gründern und intelligenten Produktideen. Das Muster hinter jedem Scheitern ist dasselbe: Das Problem war nicht das Produkt, sondern die fehlende oder falsch interpretierte Marktvalidierung vor und während der Entwicklung. Nach unserer Analyse dieser Post-Mortems lässt sich feststellen: Je höher die Finanzierung, desto größer die Gefahr, die Build-First-Falle zu übersehen.

Quibi (2020) sammelte 1,8 Mrd. USD von Hollywood-Stars und Tech-Investoren für eine Kurzvideo-Plattform. Die Annahme: Nutzer wollen hochwertig produzierte Serien in 10-Minuten-Häppchen exklusiv auf dem Smartphone. Der fatale Fehler: Quibi baute eine gigantische Infrastruktur und kaufte Lizenzen, ohne zu validieren, ob Nutzer für Inhalte zahlen würden, wenn Plattformen wie TikTok oder YouTube diesen Bedarf bereits kostenlos deckten. Nach nur sechs Monaten Laufzeit und enormen Verlusten wurde der Dienst eingestellt. Ein Landing-Page-Test hätte die fehlende Zahlungsbereitschaft früh aufgedeckt.

Juicero (2013–2017) ist das Paradebeispiel für massives Over-Engineering ohne Marktvalidierung. Das Startup entwickelte eine High-Tech-Presse für 400 Dollar, die proprietäre, DRM-geschützte Fruchtsaftsäcke verarbeitete. Trotz 120 Mio. USD Funding gab es keinen Product-Market-Fit. Das Projekt scheiterte krachend, als ein Journalist bewies, dass die Saftbeutel per Hand genauso schnell ausgedrückt werden konnten. Ein manueller Service als MVP hätte Millionen an Hardware-Entwicklungskosten gespart.

Jawbone (2006–2017) verlor den Fitness-Tracker-Wettbewerb gegen Fitbit und Apple trotz 930 Mio. USD an Investitionen. Anstatt mit einem rudimentären Tracker primär die Datengenauigkeit und den Nutzerbedarf zu testen, fokussierte sich Jawbone auf aufwendiges Design, das in der Produktion reihenweise scheiterte. Massive Hardware-Rückrufe und eine schwache Software-Ecosystem-Strategie zeigten: Das Produkt wurde für das Pitch-Deck skaliert, nicht anhand von soliden Nutzerstudien.

Pets.com (1998–2000) scheiterte spektakulär nach 300 Mio. USD Verlust. Das Team validierte nie das eigene Marktmodell, sondern investierte die Dotcom-Millionen direkt in massives Marketing und eine gigantische Einheitsgröße-für-alle Logistik. Das Problem: Hunde- und Katzenfutter ist extrem schwer und teuer zu versenden. Die negativen Unit Economics (Kosten pro Bestellung) wurden ignoriert. Eine lokale, klein skalierte Testumgebung hätte das Versandkostenproblem sofort aufgezeigt.

Zune (Microsoft, 2006–2011) war Microsofts späte Antwort auf den iPod. Technisch kompetent und mit innovativen Features wie Social Sharing ausgestattet, fehlte Zune dennoch die wichtigste Validierung: die Überprüfung der Wechselkosten. Nutzer waren bereits tief in das iTunes-Ökosystem und ihre gekauften Bibliotheken eingebunden. Die zentrale Frage „Wie bringen wir bestehende iPod-Nutzer zum Wechsel?” wurde beim Design der Go-to-Market-Strategie völlig unterschätzt.

Yik Yak (2013–2017) wuchs explosiv als anonyme Campus-App. Jedoch validierte das Team nie, ob das Nutzerversprechen über den engen College-Kontext hinaus tragfähig war, und ignorierte aufkommende Probleme wie Cybermobbing. Als das Team versuchte, Yik Yak in eine traditionellere, profilbasierte Social-Media-Plattform umzuwandeln, entfernten sie ohne echten Markttest ihre einzige USP. Ein klassischer Pivot, der die aktive Nutzerbasis über Nacht halbierte.

Secret (2014–2015) erlebte fast parallel einen identischen Bogen. Anonyme Social Apps funktionieren hervorragend als kurzes, virales Phänomen, eignen sich aber selten als Basis für ein nachhaltiges Geschäftsmodell. Das Gründerteam ließ sich vom initialen Hype blenden und glich die schwachen Retention-Metriken nie objektiv ab. Als das Design grundlegend überarbeitet wurde, brach die restliche Nutzerschaft weg, da nie validiert wurde, warum die Core-User überhaupt täglich zurückkehrten.

Sieben Startups, ein Muster: Selbst Teams mit bis zu 1,8 Mrd. USD Finanzierung scheitern an denselben strukturellen Validierungsfehlern.

Sieben Startups, ein Muster: Selbst Teams mit bis zu 1,8 Mrd. USD Finanzierung scheitern an denselben strukturellen Validierungsfehlern.

Caption: Sieben Startups, ein Muster – die Build-First-Falle trifft auch Teams mit Millionenbudgets und erfahrenen Gründern.

Moderne Alternativen: SLC, MAP & MVA

Das MVP-Konzept ist nicht falsch – es wird falsch angewendet. Die gute Nachricht: Es gibt inzwischen gut ausgearbeitete Alternativen und Ergänzungen, die spezifische Schwächen des klassischen MVP-Ansatzes adressieren. Jedes dieser Frameworks beantwortet eine andere Validierungsfrage und eignet sich für unterschiedliche Kontexte.

SLC: Simple, Lovable, Complete

SLC (Simple, Lovable, Complete) ist Jason Cohens Gegenentwurf zum MVP – der Kerngedanke: Ein Produkt muss von Anfang an vollständig in seinem versprochenen Umfang sein, darf aber einfach bleiben. Kein halbfertiger Onboarding-Flow, kein broken User Journey, keine Placeholder-Features. „Minimal” bedeutet im SLC-Ansatz nicht „kaputt” oder „unfertig”, sondern „eng fokussiert”.

Simple bedeutet: Der Scope ist bewusst klein, damit schnell gebaut und gelernt werden kann. Lovable heißt: Das Produkt muss echten Mehrwert liefern, nicht nur technisch funktionieren. Complete ist die entscheidende Ergänzung: Was auch immer das Produkt verspricht, muss es vollständig erfüllen – kein „coming soon”, keine Dead-End-Navigation.

Der SLC-Ansatz eignet sich besonders für Märkte, in denen Nutzer bereits Alternativen haben und ein weiteres halbfertiges Produkt schlicht ignorieren würden. Der erste Eindruck ist der einzige Eindruck – und ein MVP, der Nutzer frustriert, vernichtet Marktvertrauen, das kaum zurückgewonnen werden kann.

Quotable Statement: “SLC fragt nicht ‘Was ist das Minimum, das wir bauen können?’, sondern ‘Was ist das Minimum, das Nutzer tatsächlich lieben werden?’ – ein fundamentaler Perspektivwechsel.”

MAP: Minimum Awesome Product

MAP (Minimum Awesome Product) verschiebt den Fokus vom Überleben auf die Begeisterung – die zentrale These: Ein Produkt, das Nutzer nur tolerieren, wird keine organische Mund-zu-Mund-Verbreitung erzeugen. Ein Produkt, das Nutzer begeistert, schon. Der MAP-Ansatz definiert „minimum” nicht technisch, sondern durch den emotionalen Response der Zielgruppe.

Praktisch bedeutet das: Bevor Features priorisiert werden, wird definiert, welcher eine Moment im Nutzungsprozess echte Begeisterung auslösen soll – der sogenannte „Magic Moment”. Alles, was zu diesem Moment nicht beiträgt, wird gestrichen. Das klingt ähnlich wie SLC, hat aber einen anderen Ursprungsimpuls: MAP denkt von der Emotion her, SLC von der Vollständigkeit.

Der MAP-Ansatz ist besonders wirksam in Consumer-Märkten, in denen Emotion und Mund-zu-Mund-Empfehlungen wichtiger sind als Feature-Listen. Für B2B-Software mit rationalen Kaufentscheidungen ist der SLC-Ansatz oft praktikabler.

MVA: Minimum Viable Architecture

MVA (Minimum Viable Architecture) ist kein Produkt-Framework, sondern ein technisches Validierungsprinzip – es beantwortet die Frage, welche technische Infrastruktur notwendig ist, um Marktfeedback zu ermöglichen, ohne Over-Engineering zu betreiben. Direkt adressiert es das fünfte der häufigsten MVP-Fehler: technisches Scheitern vor dem PMF.

Das Kernprinzip: Baue nur die Architektur, die du heute brauchst, nicht die, die du in zwei Jahren eventuell brauchen könntest. Ein Monolith, der heute funktioniert, ist wertvoller als eine Microservice-Architektur, die die Validierungsphase um sechs Monate verlängert. Die wichtigsten MVA-Prinzipien erlauben eine schnelle erste Version, auf die später skalierbar aufgebaut werden kann – Schritt für Schritt, sobald der PMF nachgewiesen ist.

Besonders relevant ist MVA für Teams, die technisch stark sind und daher in die Over-Engineering-Falle tappen: Wenn das Team besser coden als validieren kann, ist die Versuchung groß, Infrastrukturprobleme zu lösen, die noch gar nicht existieren.

| Framework | Kernfrage | Stärke | Kontext |

|---|---|---|---|

| MVP | Was ist die kleinste testbare Version? | Hypothesentest | Neue Märkte, unklarer PMF |

| SLC | Was können Nutzer lieben, bei minimalem Scope? | Nutzererlebnis | Kompetitive Märkte mit Alternativen |

| MAP | Was begeistert Nutzer, nicht nur was genügt? | Retention & Viralität | Consumer Apps, emotionale Produkte |

| MVA | Was braucht die Architektur jetzt – nicht in zwei Jahren? | Technische Effizienz | Technisch starke Teams mit Over-Engineering-Tendenz |

Parallelen zum Großprojekt-Versagen

MVPs scheitern nicht nur in Startups. Dieselben Muster – fehlende Marktvalidierung, falsche Problemdefinition, technisches Over-Engineering – zeigen sich auch in Großprojekten der öffentlichen Hand und in etablierten Unternehmen. Gartner schätzt, dass rund 70 % aller ERP-Implementierungen ihre ursprünglichen Geschäftsziele verfehlen (Gartner, 2026) – eine Zahl, die ohne weiteres als MVP-Versagen auf Enterprise-Ebene interpretiert werden kann.

Der Unterschied zu Startup-MVPs: In Großprojekten kommt ein weiterer Faktor hinzu – politische und institutionelle Anreize, die kurzfristige Sichtbarkeit über langfristigen Nutzen stellen. Ein Großprojekt, das nach fünf Jahren und 500 Mio. Euro Fehlinvestitionen beendet wird, ist politisch schwieriger zu stoppen als ein MVP, das nach drei Monaten keine Traktion zeigt. Die Build-First-Falle trifft Institutionen härter, weil die Sunk-Cost-Psychologie durch bürokratische Strukturen verstärkt wird.

Für Gründer, die mit Unternehmenskunden arbeiten oder in stark regulierten Märkten tätig sind, ist diese Parallele praxisrelevant: Ein MVP in einem Enterprise-Kontext muss nicht nur Nutzerprobleme lösen, sondern auch institutionelle Beschaffungsprozesse überleben. Das ändert die Validierungsfragen – und erhöht die Kosten eines falschen Pivots erheblich. Unser Leitfaden zur MVP-Entwicklung im B2B-Kontext geht auf diese spezifischen Herausforderungen ein.

Die Gemeinsamkeit bleibt: Ob Startup oder Konzern, ob agiles Team oder Ministerialverwaltung – wer Validierung durch interne Überzeugung ersetzt, riskiert das Scheitern unabhängig von Budget und Erfahrung.

Fehlerkultur: Besser Scheitern lernen

Startups, die aus ihrem MVP-Scheitern systematisch lernen, haben nachweislich höhere Überlebensraten als jene, die Fehler intern tabuisieren – Resilienz war laut Deutschem Startup Monitor 2026 mit über 50 % der befragten Gründer die am häufigsten genannte Stärke von Startup-Teams. Gleichzeitig zeigt die Bitkom-Startup-Stimmungsstudie 2026, dass nur 19 % der deutschen Startups eine Verbesserung der Gesamtlage wahrnehmen – ein Zeichen, dass Resilienz zwar vorhanden, aber strukturell noch nicht gut genug in Fehlerkultur übersetzt ist.

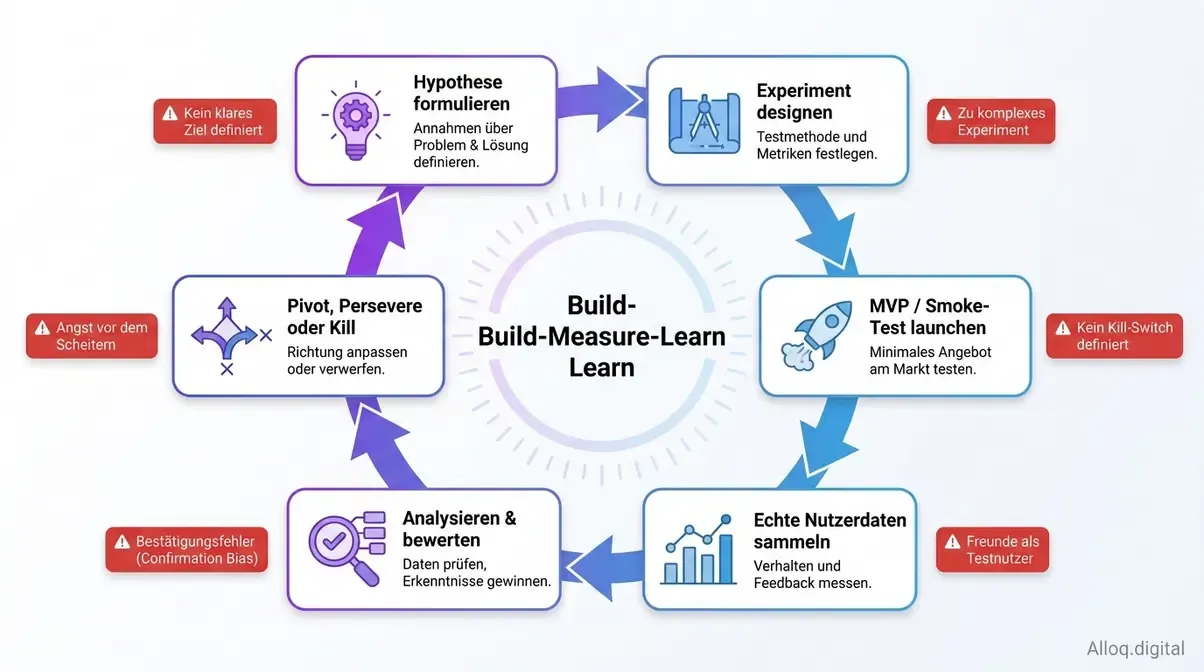

Ohne definierten Kill-Switch und klare KPIs vor dem Launch übernimmt der Sunk-Cost-Effekt die Entscheidungen — diese Feedbackschleife verhindert das.

Ohne definierten Kill-Switch und klare KPIs vor dem Launch übernimmt der Sunk-Cost-Effekt die Entscheidungen — diese Feedbackschleife verhindert das.

Der Unterschied zwischen produktiver und destruktiver Fehlerkultur liegt nicht darin, ob Fehler gemacht werden – das ist unvermeidbar. Er liegt darin, ob sie dokumentiert, analysiert und institutionalisiert werden. Ein Post-Mortem nach einem gescheiterten MVP ist nur dann wertvoll, wenn es ehrlich ist: Wer hat welche Warnsignale ignoriert? Welche Annahmen haben sich nicht bewährt? Was hätte anders entschieden werden müssen?

Die Fehlermanagementkultur, wie sie Starting-Up.de beschreibt, unterscheidet sich dabei von oberflächlicher „Fail Fast”-Rhetorik: Es geht nicht darum, Fehler zu feiern, sondern darum, systematische Prozesse zu etablieren, die Wiederholung verhindern. Konkret bedeutet das für MVP-Teams:

- Hypothesen vor dem Launch dokumentieren: Was muss wahr sein, damit dieser MVP erfolgreich ist? Falsche Annahmen werden so nach dem Launch sichtbar.

- Metriken vor dem Launch definieren: Welche Zahl beweist Erfolg oder Scheitern? Ohne klare KPIs ist jedes Feedback interpretierbar.

- Externe Perspektiven systematisch einbauen: Advisor, Mentoren und kritische Nutzer müssen aktiv eingeladen werden, nicht nur die Befürworter.

Für den deutschen Markt ist das besonders relevant: Die Angst vor dem öffentlichen Scheitern ist kulturell tiefer verankert als in US-amerikanischen Startup-Ökosystemen – was valide Kritik am eigenen MVP intern noch schwieriger macht. Wer diese kulturelle Barriere als strukturelles Risiko begreift und bewusst gegensteuert, hat bereits einen messbaren Validierungsvorteil.

Fallstricke & MVP-Alternativen

Häufige Fehler bei der MVP-Umsetzung

Neben den fünf großen Scheiternsgründen gibt es eine Reihe wiederkehrender operativer Fehler, die das Scheitern begünstigen, aber oft übersehen werden:

- Zu frühe Skalierung von Marketing: Teams beginnen bezahlte Kundenakquise, bevor die Retention-Metriken stabil sind. Das verbrennt Budget für Nutzer, die sowieso nicht bleiben.

- Inhomogene Zielgruppe im Early Access: Wer jeden als Early Adopter zulässt, bekommt inkonsistentes Feedback. Die ersten 50 Nutzer sollten so homogen wie möglich sein – gleiche Branche, gleiches Problem, gleiches Verhaltensmuster.

- Kein klares Scheiternsszenario definiert: Wer keinen vorher definierten „Kill Switch” hat – eine Metrik, bei deren Unterschreitung das Projekt beendet wird – lässt Sunk Cost die Entscheidungen übernehmen.

- Feedback von Freunden und Familie: Soziales Wohlwollen ist keine Marktvalidierung. Testnutzer müssen echte Probleme haben und keine emotionale Verbindung zum Gründer.

Wann ein MVP nicht die richtige Wahl ist

Ein MVP ist kein universelles Werkzeug. In bestimmten Kontexten ist ein anderer Ansatz sinnvoller – oder zunächst eine noch einfachere Validierungsform angemessen:

Hochregulierte Branchen (Medizinprodukte, Finanzdienstleistungen, Luftfahrt): Hier sind Mindestanforderungen an Compliance und Zertifizierung so hoch, dass ein „Minimum” Viable Product de facto ein vollständiges Produkt sein muss. In diesem Kontext lohnt eine tiefere Vorabanalyse mehr als ein schneller Launch.

Hardwareprodukte mit hohen Produktionskosten: Wenn jeder Prototyp 50.000 € kostet, ist der Iterationsansatz des MVPs wirtschaftlich nicht tragfähig. Hier ersetzt ausgiebige Nutzerforschung (Interviews, Ethnografien, konzeptuelle Tests) den physischen MVP. Um diese komplexen Entscheidungen im Detail zu verstehen, hilft ein Blick auf die häufigsten Fragen, die Teams rund um MVPs stellen.

FAQ: Häufig gestellte Fragen zu MVPs

Warum scheitern die meisten MVPs?

Die mit Abstand häufigste Ursache ist der fehlende Marktbedarf für das fertige Produkt. Rund 42 Prozent aller gescheiterten Startups investieren Monate in die Entwicklung eines Featuresets, das echte Nutzer gar nicht verlangen (CB Insights, 2026). Oft verwechseln Gründer dabei das eigene Bauchgefühl mit validierten Marktdaten. Um dies zu verhindern, muss das Problem vor dem eigentlichen Produkt rigoros validiert werden.

Wie erkennt man, ob ein MVP gescheitert ist?

Ein klares Zeichen für ein gescheitertes MVP ist das Ausbleiben von organischem Wachstum oder echten Kaufabschlüssen nach dem Launch. Wenn Nutzer zwar höfliches Feedback geben, aber keine Zeit oder Geld in die Nutzung investieren wollen, fehlt die Validierung. Zudem deutet eine hohe Absprungrate direkt nach dem Onboarding darauf hin, dass der erwartete Mehrwert nicht geliefert wird. Letztlich ist das Ausbleiben von wiederkehrenden Nutzern das gefährlichste Symptom.

Was ist der Unterschied zwischen MVP und Prototyp?

Ein Prototyp testet in der Regel die technische Machbarkeit oder das Design einer einzelnen Funktion, oft ohne echte Marktumgebung. Ein MVP hingegen ist darauf ausgelegt, eine Geschäftshypothese im echten Markt mit echten Kunden zu validieren. Während ein Prototyp im Labor funktioniert, muss ein MVP wertvolle Erkenntnisse über das echte Nutzerverhalten unter realen Bedingungen liefern.

Wie viel darf ein MVP kosten?

Die Kosten variieren stark nach Branche, sollten aber stets auf das absolut Notwendige für die Validierung begrenzt sein. Bei Software-MVPs liegt das Budget für eine erste Testversion oft zwischen 10.000 und 50.000 Euro, abhängig von der Komplexität. Der entscheidende Faktor ist nicht das Gesamtbudget, sondern die Maximierung des Lerneffekts pro investiertem Euro. Teures Over-Engineering vor dem Product-Market-Fit ist strikt zu vermeiden.

Wie lange sollte die MVP-Entwicklung dauern?

Ein starkes Ziel für digitale Produkte ist es, das erste MVP innerhalb von vier bis zwölf Wochen auf den Markt zu bringen. Längere Entwicklungszyklen erhöhen das Risiko von Feature Creep und der Build-First-Falle drastisch. Je schneller Teams erstes Nutzerfeedback integrieren, desto geringer ist die Gefahr, wertvolle Zeit und Budgets in die falsche Richtung zu investieren.

Fazit: Validierung vor Entwicklung

Die Analyse der häufigsten Scheiternsgründe zeigt ein klares Bild: MVPs sterben selten an schlechtem Code, sondern an mangelnder Marktorientierung und toxischen Annahmen. Wer den Minimum-Gedanken ernst nimmt, testet Hypothesen systematisch, bevor die erste teure Code-Zeile geschrieben wird. Die „Build-First-Falle“ lässt sich nur vermeiden, wenn Feedbackschleifen radikal verkürzt und moderne Alternativen wie SLC, MAP oder MVA strategisch zum Einsatz kommen. Ein MVP ist niemals das Endprodukt, sondern der Startpunkt für echtes Lernen.

Stehst du kurz vor dem Bau deines nächsten digitalen Produkts und willst teure Fehler vermeiden? Das Team von Alloq unterstützt B2B-Unternehmen und Startups dabei, MVPs mit Fokus auf echte Validierung und architektonische Skalierbarkeit zu entwickeln. Kontaktiere uns für einen strukturierten MVP-Workshop und wir bringen gemeinsam dein Produkt auf den richtigen Erfolgspfad.